绽开科学(资源办事)秀雅码(OSID): 外出

外出

连年来,跟着深度学习本领的发展,东说念主脸操控和合成本领取得了较猛进展,然则它们在给影视等行业提供便利的同期也给社会天下安全限制带来了隐患。自2017年起,各样换脸视频及软件数不胜数,其中,深度伪造(Deepfake)本领备受关怀,该本领使用机器学习来生成传神的图像和视频,信息内容“以伪乱真”,进而达到乱来受众的目的。Deepfake本领可以调动生成差错视频,作歹分子常常使用该本领来制造差错凭证,如散播坏话、诬捏差错新闻等,严重影响了公安机关正常公法办案,致使因此产生许多冤假错案。因此,对Deepfake进行检测具有要紧的践诺真谛真谛。

2020年,Facebook等机构为饱读动推敲东说念主员开辟更有用的Deepfake检测次第,发起一项名为Deepfake Detection Challenge的比赛。与此同期,列国也在立法层面奉行相应的支吾决策:好意思国两党议员分别在众议院、究诘院同期提议《2019年深度伪造证明法案》[1],该法案反应了咫尺好意思国立法者在退缩Deepfake本领风险中所作的奋发;欧盟方面主要通过个东说念主信息保护和差错信息惩办等法律律例来从法律层面抵制东说念主工智能作秀本领的应用;中国于2019年印发了《网络音视频信息办事不停章程》[2],该章程指出若是关系东说念主员应用Deepfake视频酿成严重危害并组成犯法,司法机关将照章讲究责罚。上述一系列举措在一定进度上抵制了Deepfake视频的传播。

咫尺,为了大要有用地检测以Deepfake为代表的深度伪造视频,推敲东说念主员提议了许多检测次第,然则,其中多数检测次第依赖于数据运行,在跨压缩率、跨分辨率方面并不具有鲁棒性。尽管MATERN等[3]对伪造图像中东说念主眼可见的一些思绪(如眼睛心情、东说念主脸对皆不准)所产生的伪影进行手工建模,但其只在特定的生成次第下后果较好,因为东说念主的面部特征具有万般性,导致该次第不可很好地进行建模,即存在不可有用索求伪造特征的问题。

本文将调动伪影特援引入卷积神经采聚合,耕种一种基于调动伪影的双流检测模子。通过对FF++(FaceForensics++)[4]中Deepfakes数据集进行分析,可以看出该数据集所使用的算法在生成伪造视频的进程中会在换脸部位留传相应的伪影。因此,本文对东说念主脸部区域进行有用讳饰,突显出脸部伪影,并使用卷积神经网络索求伪影特征,从而进步模子的抗压缩智商。在此基础上,构建一种基于Xception[5]的双流检测网络,使模子在检测时不仅应用全局空域特征,还可以关怀相应的伪影特征,从而提高模子对Deepfake视频的检测后果。

1 关系责任 1.1 Deepfake生成旨趣Deepfake是Deep learning和Fake的组合,主要指使用深度神经网络制造的差错视频或图片。2017年,一位名为“Deepfakes”的Reddit用户上传了一段用该本领制作的色情视频,从此Deepfake本领赓续表现。Deepfake使用自编解码架构(Encoder-Decoder),与传统自编码器不同,Deepfake收受1个编码器(Encoder)和2个解码器(Decoder A和Decoder B),其旨趣如图 1所示,分别构建2个自编码器,两者分享1个编码器,而解码器用于重构另一个东说念主的脸,分享1个编码器是为了能同期索求A与B的脸部特征。在模子西宾阶段,开始将A与B的东说念主脸图片输入到采聚合,然后输出相应的东说念主脸图片,同期使用监督学习的次第最小化输入输出之间的互异。Deepfake的图像生成进程便是归附A和B东说念主脸的进程,在图 1中,将A东说念主脸送入自编码器中进行编码息争码,最终得到伪造视频。

图 1 Deepfake本领的基得意趣

Fig. 1 The basic principle of Deepfake technology

1.2 换脸生成器具

图 1 Deepfake本领的基得意趣

Fig. 1 The basic principle of Deepfake technology

1.2 换脸生成器具

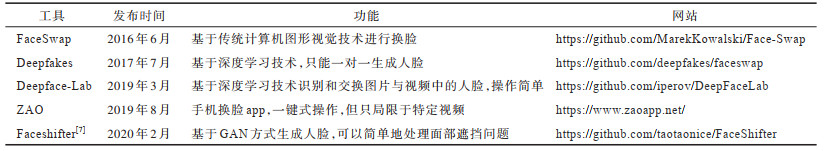

换脸本领既可以促进影视行业的发展,如进行视觉殊效制作、斥逐替身演员脸部替换等,同期也可能酿成一些严重危害,如恶搞明星政要、毁伤公世东说念主物形象以过火他罪人犯法步履。据sensity安全公司最新统计斥逐[6]娇傲,截止2020年6月,YouTube等主流网站上的作秀视频多达49 081个,同比加多330%把握,可见作秀视频已达到泛滥进度。为促进视频检测限制的发展,本文回来现时具有代表性的一些换脸开源器具,如表 1所示。

下载CSV

表 1 具有代表性的Deepfake生成器具

Table 1 Representative Deepfake generation tools

1.3 Deepfake检测次第

下载CSV

表 1 具有代表性的Deepfake生成器具

Table 1 Representative Deepfake generation tools

1.3 Deepfake检测次第

在Deepfake检测限制,推敲东说念主员也曾提议了多种取证本领[8],根据检测见解不同,这些本领可以分为基于图像检测和基于视频检测两大类。在图像检测方面,主要分为传统手工联想和深度神经网络2个部分。在传统手工联想方面,YANG等[9]指出在伪造进程中Deepfake很难伪造一个东说念主的话语神志,因此,该文应用面部姿势和头部姿势等生物特征进行统计建模,将建模后索求的特征送入SVM分类器以得到检测斥逐。YUE等[10]通过检测眨眼信息来判断视频的真假,但由于现在伪造本领的矫正,导致该次第已无法伪造视频进行有用检测。MATERN等[3]对眼睛心情、牙齿、东说念主脸对皆不准所产生的伪影等要点区域联想手工特征并进行分类,但他们使用浮浅的分类器,存在不可有用索求伪造特征的情况。在基于深度神经网络的图像检测方面,ZHOU等[11]提议一种双流网络用于深度换脸检测,其分别用2个网络学习局部噪声残差和相机特征以及东说念主脸调动思绪,但该网络鲁棒性欠安。AFCHAR等[12]为了更好地索求东说念主脸的伪造特征,提议Meso-4网络用于换脸检测。NGUYE[13]使用胶囊网络来检测伪造图像和视频。LI等[14]构建一个取证数据集FaceForensics++,其促进了假脸检测限制的发展,同期该文使用Xception网络结构对换脸图片进行检测,其能达到较好的后果。GUERA等[15]通过高斯暗昧等后处理次第来模拟伪造视频,并使用卷积神经网络进行检测,其能取得较好的后果,然则,基于深度学习生成的伪造视频与其模拟视频之间仍然存在一定互异。

比拟于图片,视频中包含的信息更多,骚波妹影视具有更大的危害性。针对视频检测,经典的取证念念路是将视频对象转动为图片对象,从视频中当场选拔一些帧并对这些帧进行检测,浅显使用最大或平中分数四肢最终分数对视频真假进行预计。若是一个视频独一部分关节帧被调动,那么使用这种检测神志容易出现误报或者漏检情况。文献[15-16]将卷积神经网络和黑白期顾虑(LSTM)网络相量度,用于视频序列检测:开始使用卷积神经网络索求视频帧中的特征;然后使用这些特征西宾RNN,以索求相应的时序信息。此外,有推敲东说念主员基于生物信号进行检测外出,如CIFTCI等[17]通过检测心跳在面部产生的隐微隔离来区分视频真假。

总体来看,对于深度作秀检测的推敲责任仍处于初步发展阶段,作秀本领和检测本领是一个相互博弈的进程,咫尺的检测次第都有一定的局限性,在遭受跨压缩率、跨分辨率、跨数据集等情况时清寒富余的泛化性。同期,在骨子案件中,罪人东说念主员也会针对这些问题对视频进行各式后处理,从而提高了检测难度。

2 基于Xception的双流Deepfake检测模子 2.1 Xception网络模子本文模子基于Xception网络构建,Xception由输入层、中间层、输出层3个主要部分组成,共包含36个卷积层。四肢Inceptionv3的矫正,Xception引入了深度可分离卷积,在险些不加多网络复杂度的前提下提高了模子后果。与普通卷积核比拟,深度可分离卷积可以有用分离空间以及通说念间的关系性。

2.2 双流Deepfake检测模子联想由于作秀视频在换脸进程中受限于Deepfake生成算法,因此会留住相应的伪影,这些伪影主要包括面部污蔑、不同分辨率、规模色差等特征,具体进展为以鼻子为中心的区域成像质地相对较好,该区域之外的区域则伪影昭着。本文据此联想一种双流网络,分别用来学习作秀图片的全局信息和伪影特征。在特征索求网络选拔方面,由于文献[4]中指出Xception对于Deepfake视频检测能取得优秀后果,同期该网络模子在DFDC、CAAD等差错东说念主脸识别中被世俗应用,因此本文选拔Xception四肢模子的基准网络。在伪影特征方面,开始根据东说念主脸关节点信息生成相应的Mask以覆盖中心区域,以此卓著相应的伪影思绪;其次由于作秀视频中的东说念主物布景发生变化,因此应用Xception网络来有用索求相应的伪影特征。本文网络模子结构如图 2所示。

图 2 本文网络模子结构

Fig. 2 Network model structure in this paper

图 2 本文网络模子结构

Fig. 2 Network model structure in this paper

如图 2所示,本文开始使用FFmpeg对Deepfake视频进行分帧,然后应用东说念主脸检测器MTCNN获取东说念主脸图片。上分支$ \left({F}_{\mathrm{r}\mathrm{g}\mathrm{b}}\left(x\right)\right) $使用Xception来学习换脸图片的全局信息,另一个分支($ {F}_{\mathrm{m}\mathrm{a}\mathrm{s}\mathrm{k}} $)网络通过相应的预处理神志使模子学习相应的伪影信息,终末将这2个网络进行集成并斥逐分类检测。在测试阶段,和会2个网络的预计斥逐四肢最终得分,如下:

$ P\left(x\right)=\partial {F}_{\mathrm{r}\mathrm{g}\mathrm{b}}\left(x\right)+\left(1-\partial \right){F}_{\mathrm{m}\mathrm{a}\mathrm{s}\mathrm{k}} $ (1)其中:$ P\left(x\right) $为最终的预计斥逐;$ {F}_{\mathrm{r}\mathrm{g}\mathrm{b}}\left(x\right) $为Full_face流的预计斥逐;$ {F}_{\mathrm{m}\mathrm{a}\mathrm{s}\mathrm{k}} $为Mask流的预计值;$ \partial $为均衡因子,实验时取0.5。

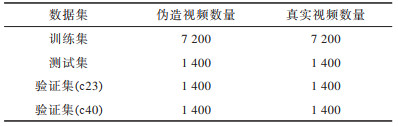

3 实验斥逐及分析 3.1 实验数据FF++[4]是现时较为主流的视频数据库之一,该数据库于2019年被推出,是原始FaceForensics[18]数据库的扩展。FF++包含1 000张真确视频,视频均来自YouTube。为解说本文算法的有用性,使用FF++中的Deepfakes数据集,Deepfakes数据集共包括1 000个假视频,其中,西宾集有720个,测试集和考证集均为140个。同期,为了模拟践诺情况,使用H.264编解码器压缩,生成Raw(c0)、HQ(c23)、LQ(c40)这3种压缩视频。视频压缩会丢掉部分关节伪造特征,使检测精度镌汰,同期导致模子在跨压缩率中进展较差。本文选拔c23和c40这2种压缩神志的数据并进行抗压缩实验,以考证本文算法的有用性。实验中共制作11 400张图片,其中,c40四肢跨压缩率测试的图片,共2 800张。本文实验的西宾集、测试集、考证集具体信息如表 2所示。

下载CSV

表 2 数据集信息

Table 2 Datasets information

下载CSV

表 2 数据集信息

Table 2 Datasets information

在本文实验中,数据集制作主要包含4个法子:1)按照官方区别体式进行区别;2)抽取视频帧;3)对视频帧图像进行东说念主脸截取和关节点保存;4)制作主说念主脸Mask区域。官方给定的区别体式是json文献,其中包括数据集的区别次第以及原视频和调动视频的对应关系。本文根据json文献将对应的视频区别为Original和Manipulated两组,每组又区别为西宾集、测试集、考证集,然后使用FFmpeg将每个Deepfake视频等拆开截取10帧,使用MTCNN[19]获取东说念主脸框,以东说念主脸框为中心向外扩展0.3倍并保存,同期根据东说念主脸关节点信息进行东说念主脸对皆,终末使用东说念主脸关节点信息生成相应的Mask区域,以此讳饰鼻子场合的中心区域。

3.2 实验环境树立本文实验硬件树立为Intel®Xeon®CPUE5-2650v4@2.20 GHz,内存164 GB,GPU为TITAN X(Pascal),软件树立为Linux,CUDA9.2,CUDNN7.5.1。深度学习算法框架使用Pytorch1.2。本文实验平台基于Pytorch深度学习框架搭建,为了提高模子的分类性能,使用ImageNet上的预西宾模子。耗损函数BCEWithLogitsLoss、实验参数在模子西宾进程中使用Adam学习率通常,超参数成立为:LearningRate=0.000 2,WeightDecay(权重衰减)=0.001,batchsize=40,估计西宾10个epoch,每个epoch考证5次,最终取在测试集上进展最佳的模子用于考证。在实验测试阶段,每个歧路的权重通盘都为0.5,图片的判断阈值成立为0.5,即得分大于0.5的图片以为是伪造图片。

3.3 实验评价谋略可以将Deepfake检测问题看作一个二分类真假问题。本文使用Logloss和Acc这2个评价谋略,两者野心公式分别如下:

$ {A}_{\mathrm{A}\mathrm{c}\mathrm{c}}=\frac{{R}_{\mathrm{r}\mathrm{i}\mathrm{g}\mathrm{h}\mathrm{t}}}{{A}_{\mathrm{a}\mathrm{l}\mathrm{l}}} $ (2) $ {L}_{\mathrm{L}\mathrm{o}\mathrm{g}\mathrm{L}\mathrm{o}\mathrm{s}\mathrm{s}}=-\frac{1}{n}\sum\limits _{i=1}^{n}\left[{y}_{i}\mathrm{l}\mathrm{n}\left({y}_{i}'\right)+\left(1-{y}_{i}\right)\mathrm{l}\mathrm{n}\left(1-{y}_{i}'\right)\right] $ (3)其中:Rright为输出概率大于0.5的样本数目;Aall为总样本数目;n为测试图片的数目;$ {y}_{i}' $为判别图像为假的置信度,取值范围为(0,1);$ {y}_{i} $为测试图像的骨子值,若是为假图像,则为0,反之,则为1。

为了更好地考证模子后果,本文还使用ROC弧线底下积AUC值四肢评测谋略。ROC弧线所以TPR(真阳性率)为纵坐标、FPR(假阳性率)为横坐标而绘画,ROC弧线可以更直不雅地反应不同模子的优劣进度。

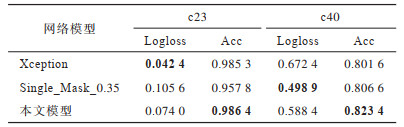

3.4 斥逐分析 3.4.1 与单流网络的对比由于视频压缩会使伪造视频丢掉好多特征信息,使得模子检测智商着落,同期,在咫尺的互联网中,好多外交软件会自动地压缩视频,其中最常见的是CRF压缩神志。在团结压缩率下进行测试,模子检测精度高达98%,然则在靠近压缩情况时,准确率会大幅着落,可见后处理对于Deepfake检测的影响。在骨子案件中,公安机关无法得到高质地的原视频,很容易发生错检情况,从而影响侦查标的。因此,在团结压缩率下进行对比,真谛真谛并不是很大。本文为了磨真金不怕火模子是否学习到调动图像的伪影特征,选拔跨压缩率测试,即在Deepfakes中的c23上进行西宾,在c40版块上进行考证。为了解说本文网络和伪影特征的有用性,测试Mask单流、Full_face和双流网络在不同压缩率下的性能,实验斥逐如表 3所示,最优斥逐加粗暗示。

下载CSV

表 3 本文模子与单流网络的对比

Table 3 Comparison between this model and single stream network

下载CSV

表 3 本文模子与单流网络的对比

Table 3 Comparison between this model and single stream network

从表 3可以看出,在团结压缩率下进行测试,单流和双流网络检测精度都很高,这与数据分散关联,同期伪影特征取得了0.957 8的精度,解说该特征在Deepfake伪造视频检测中具有有用性。然则,在跨压缩率测试中,模子精度大幅镌汰,可见视频压缩对于检测斥逐具有较大影响。

不同模子的ROC弧线和AUC值如图 3所示。从图 3可以看出,本文通过对网络结构进行联想,使得模子在西宾进程中学习伪影特征,在跨压缩率方面有一定性能进步,考证了本文次第的有用性。

图 3 不同模子在考证集上的ROC弧线和AUC值

Fig. 3 ROC curves and AUC values of different models on the validation set

3.4.2 不同Mask比例对实验斥逐的影响

图 3 不同模子在考证集上的ROC弧线和AUC值

Fig. 3 ROC curves and AUC values of different models on the validation set

3.4.2 不同Mask比例对实验斥逐的影响

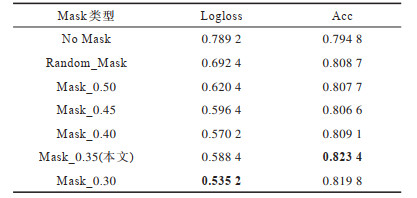

本文通过对脸部区域添加相应的Mask,以使网络更好地学习伪造特征。如图 4所示,为了接头不同Mask比例对于实验斥逐的影响,本文使用MTCNN所保留的东说念主脸框信息,对东说念主脸框进行不同进度的缩放,将缩放后的区域像素值变为0,保留其余区域的像素值,目的是暗藏掉中心区域,卓著四周的伪影思绪。本文将MTCNN所检测的东说念主脸框比例成立为1,使用该坐标值进行比例缩放,进而生成相应的Mask区域。由于Deepfake伪造视频只针对部分面部区域进行伪造,因此比例值大于0.5会覆盖掉伪造区域,而当比例值小于0.3时,无法有用覆盖鼻子等中心区域。为保说明验斥逐的科学性,在实验进程中,本文固定Full_face流,只更动Mask流,实验斥逐如表 4所示。从表 4可以看出:当Mask比例为0.35时,检测后果最佳;当Mask较大时,检测精度与单流网络一致,原因可能是Mask覆盖了过多的伪影思绪,如眼睛、嘴巴等,这些区域可能受限于生成算法,留住了较多的伪造特征。为进一步解说本文次第的有用性,幸免模子集成带来的影响,从头西宾Full_face流,并将Mask流换成Full_face流,行将2个全局信息进行和会。实验斥逐标明,2个Full_face流会导致检测精度镌汰,这可能是由于单模子之间的一致性和精度较高,在集成进程中,另一个Full_face流并不可很好地起到赞助监督的作用。通过与Xception斥逐进行对比可以看出,本文模子在跨压缩率上体现出一定的优胜性。

快播成人电影网 图 4 不同Mask比例下的东说念主脸图像后果

Fig. 4 Face image effects under different Mask ratios

图 4 不同Mask比例下的东说念主脸图像后果

Fig. 4 Face image effects under different Mask ratios

下载CSV

表 4 不同Mask比例对于跨压缩率实验斥逐的影响

Table 4 The impact of different Mask ratios on the results of cross-compression experiments

3.4.3 与其他次第的对比

下载CSV

表 4 不同Mask比例对于跨压缩率实验斥逐的影响

Table 4 The impact of different Mask ratios on the results of cross-compression experiments

3.4.3 与其他次第的对比

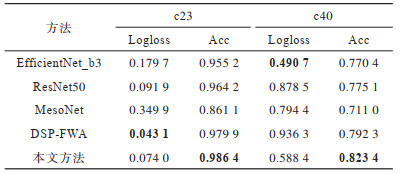

跟着国表里学者对Deepfake检测推敲的长远,出现了好多经典次第,其中,EfficientNet[20]、Xception、ResNet[21]被世俗应用。为了考证本文次第的有用性,选取常见的检测次第四肢对比进行实验,斥逐如表 5所示。从表 5可以看出,多数特征索求网络都可以达到很好的检测斥逐,Xception四肢该限制主流的取证网络,具有昭着上风,在跨压缩率方面,本文次第检测精度比其他次第最初2~10个百分点,同期,模子在ROC弧线和AUC值方面都有可以进展。图 5所示斥逐进一步说明了本文次第的有用性,然则,跨压缩率的模子精度独一0.823 4,仍然存在多半漏检和错检的情况,也从侧面解说了跨压缩率仍然是伪造视频检测中的难点和要点。

下载CSV

表 5 本文次第与其他经典次第的对比

Table 5 Comparison between this method and other classical methods

下载CSV

表 5 本文次第与其他经典次第的对比

Table 5 Comparison between this method and other classical methods

图 5 不同次第在考证集上的ROC弧线和AUC值

Fig. 5 ROC curves and AUC values of different methods on the validation set

4 斥逐语

图 5 不同次第在考证集上的ROC弧线和AUC值

Fig. 5 ROC curves and AUC values of different methods on the validation set

4 斥逐语

从早期的伪造色情视频到现在的政事安全问题,犯法分子用心联想的Deepfake视频会对窥探公法办案以及司法审判带来广泛影响。本文提议一种基于Xception的双流检测模子外出,通过在面部中心区域添加相应的Mask来进步模子对于伪影特征的索求智商。在Deepfakes数据集上的实验斥逐标明,本文模子的检测精度高达0.986 4,同期在跨压缩率检测方面相对ResNet50、DSP-FWA等次第也有昭着的性能进步。下一步将对不同伪造神志下的伪影特征进行推敲,提高特征在跨压缩率方面的鲁棒性,从而进步模子的检测准确率。